「ChatGPTは便利だけど、うちの社内情報には答えてくれない」——そんな経験をお持ちの方は多いのではないだろうか。

汎用AIには限界がある。インターネット上の一般知識で回答するため、「御社のマニュアルに書いてある手順」や「過去に御社で発生したトラブルの対処法」は知らない。この限界を突破する技術が、RAG(検索拡張生成)だ。

本記事では、RAGの仕組みを専門用語なしで解説し、汎用AIとの違い、セキュリティ設計の考え方までを網羅する。

この記事で得られること:

- RAG(検索拡張生成)の仕組みを、専門用語なしで理解できる解説

- ChatGPT等の汎用AIと業務特化AI(RAG)の本質的な違い

- ハイブリッド型アーキテクチャによるセキュリティ設計の全体像

目次

- ChatGPT等の汎用AIの限界

- RAGとは何か――「自社データで回答するAI」の仕組み

- 「汎用AI」vs「業務特化AI(RAG)」徹底比較

- セキュリティ設計――ハイブリッド型アーキテクチャの仕組み

- まとめ

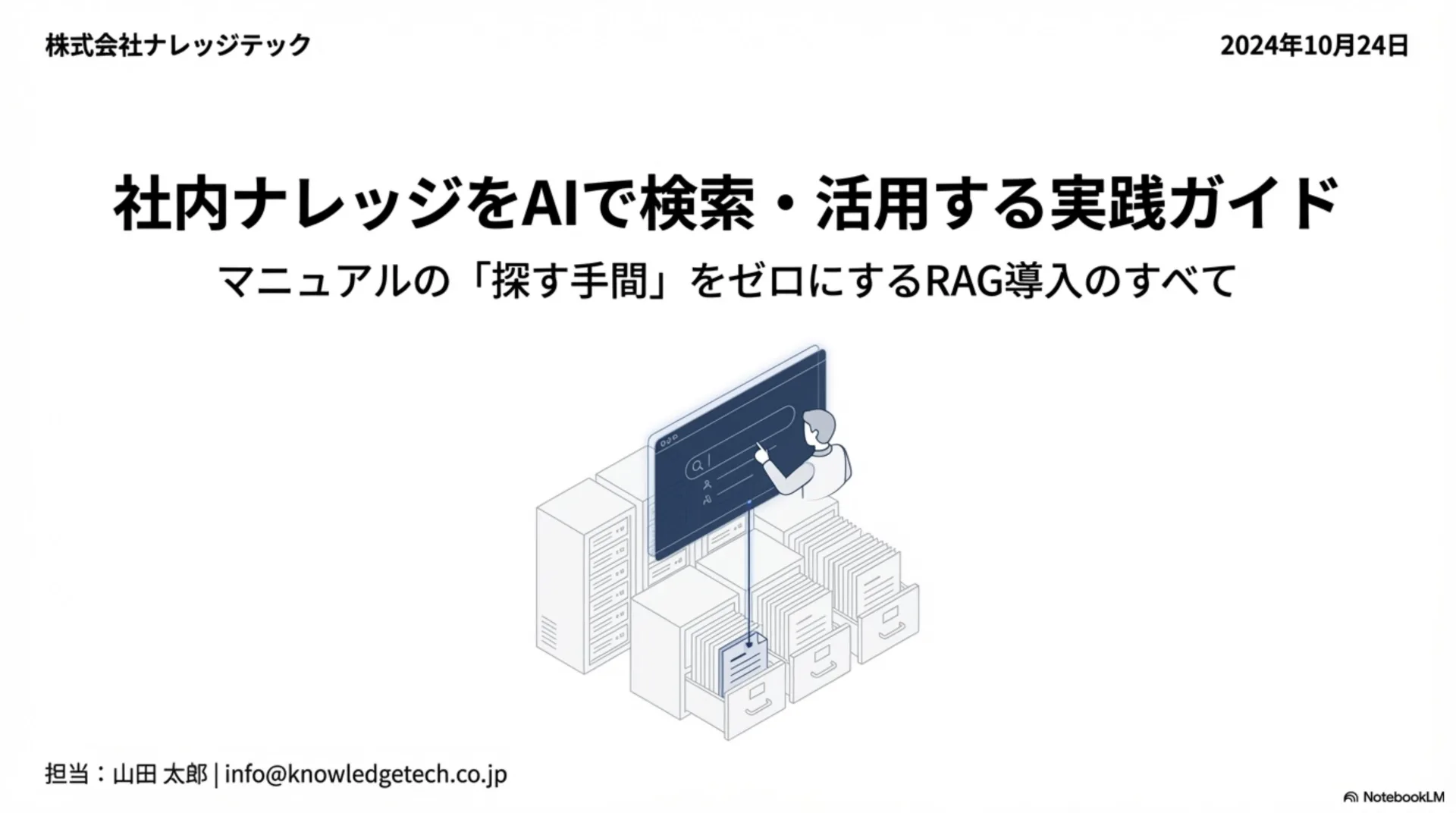

1. ChatGPT等の汎用AIの限界

ChatGPTやClaudeといった汎用AIは、インターネット上の膨大な情報をもとに「一般的な知識」で回答する。しかし、「御社のマニュアルに書いてある手順」や「過去に御社で発生したトラブルの対処法」は知らない。

汎用AIに社内のことを質問すると、一般論で答えるか、あるいは事実と異なる回答(ハルシネーション)を生成するリスクがある。汎用AIの問題は「嘘をつく」ことではなく、「御社のことを何も知らないまま、知っているように答えてしまう」ことだ。

この問題を解決するのが、RAG(Retrieval-Augmented Generation:検索拡張生成)という仕組みである。

2. RAGとは何か――「自社データで回答するAI」の仕組み

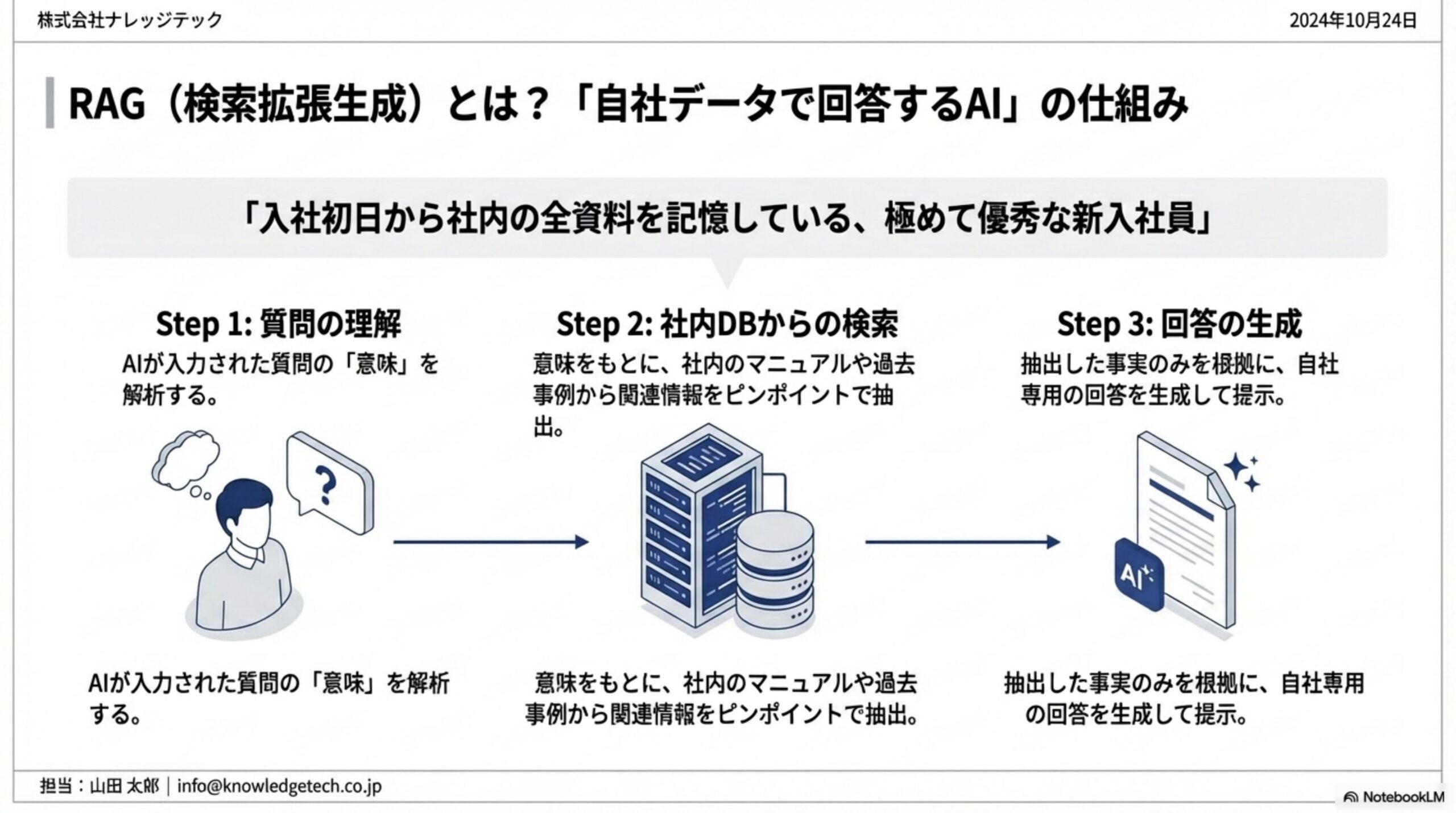

RAGは3つのステップで動作する。

ステップ1: 質問の理解

ユーザーが入力した質問の「意味」をAIが解析する。

ステップ2: 社内データベースからの検索

質問の意味をもとに、社内のナレッジベース(マニュアル・事例集・対応履歴等)から関連性の高い情報を検索する。

ステップ3: 回答の生成

検索結果をもとに、AIが回答を生成する。根拠となる社内データが明示されるため、汎用AIのような「なんとなくそれらしい回答」ではなく、「御社の情報に基づいた回答」が返ってくる。

わかりやすくたとえるなら、「非常に優秀な新入社員」だ。入社初日は何も知らないが、社内のマニュアルや資料をすべて読み込み、必要なときに瞬時に参照して回答できる——それがRAGの設計思想に近い。ナレッジベースに新しい情報を追加すれば、即座にAIの回答に反映される点も、人間の新入社員にはない強みだ。

3. 「汎用AI」vs「業務特化AI(RAG)」徹底比較

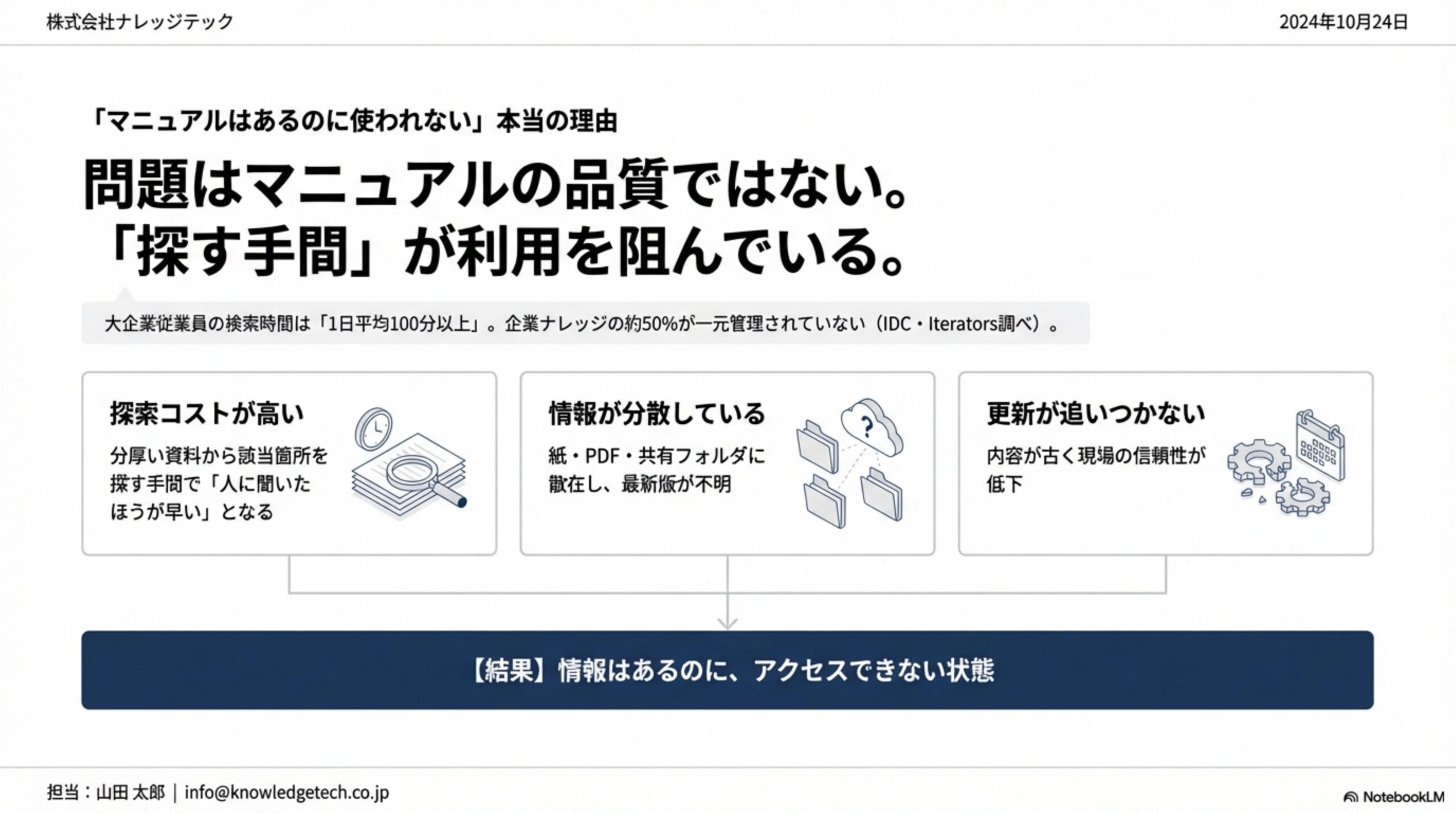

【パターンA: ChatGPT単体(汎用AI)】

社員の質問 回答

「うちの溶接工程の ──→ 「一般的な溶接の注意点は

注意点は?」 以下の通りです...」

↑

インターネット上の

一般知識から回答

(御社の固有情報は知らない)

× 御社のマニュアルの内容は答えられない

× 過去のトラブル事例は参照できない

× 一般論しか返ってこない

【パターンB: 業務特化AI(RAG = ナレッジの番人)】

社員の質問 回答

「うちの溶接工程の ──→ 「御社のライン3溶接工程では

注意点は?」 以下の3点が重要です。

過去のトラブル事例として

2024年8月の事例が...」

↑

御社のナレッジベースから

固有情報を検索して回答

(御社専用のAI)

○ 御社のマニュアルを参照して回答

○ 過去のトラブル事例も検索対象

○ 御社専用の「AI社員」として機能| 比較項目 | 汎用AI(ChatGPT等) | RAG(業務特化型AI) |

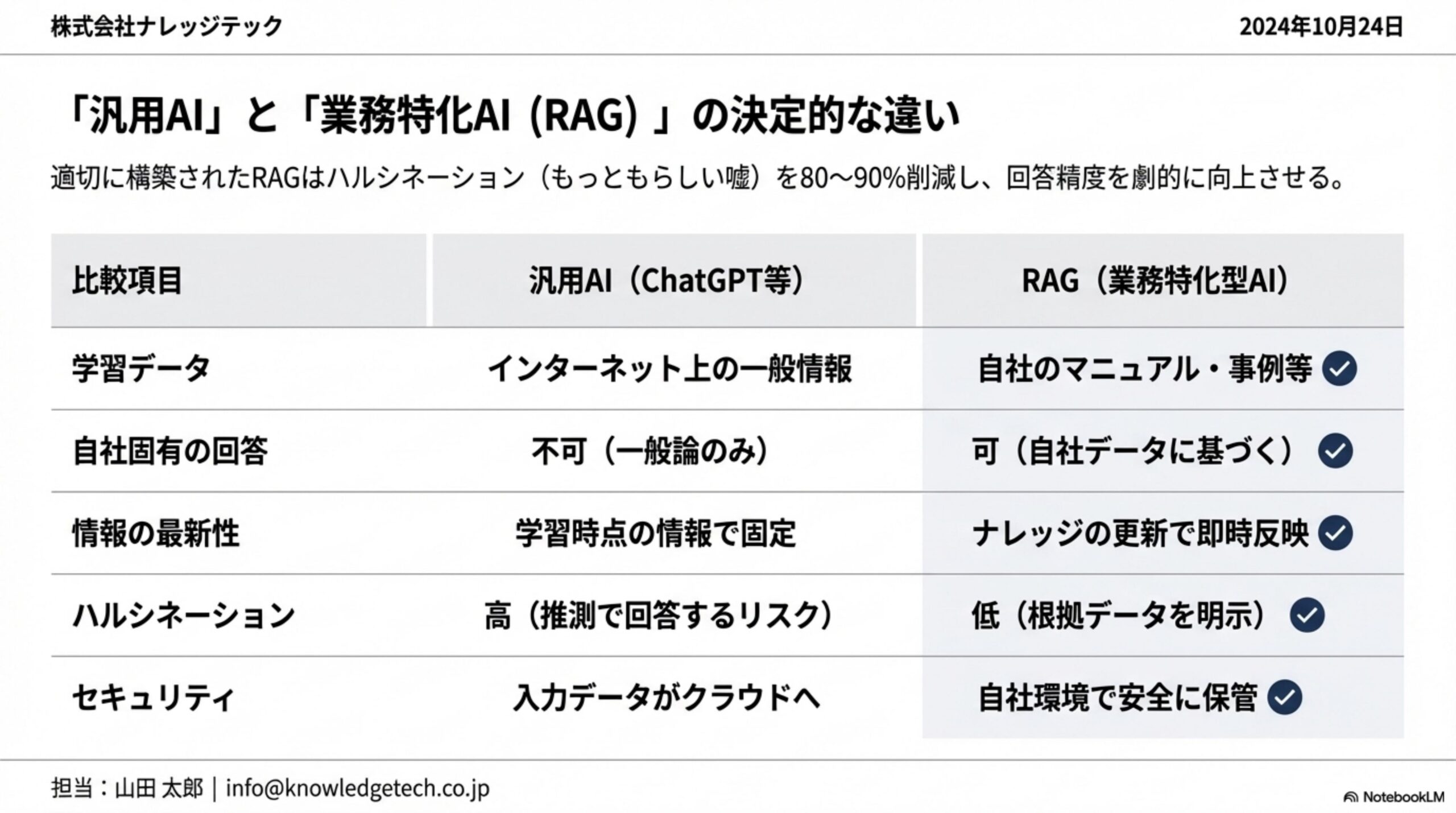

|---|---|---|

| 学習データ | インターネット上の一般情報 | 自社のマニュアル・事例等 |

| 自社固有の回答 | 不可(一般論のみ) | 可(自社データに基づく回答) |

| 情報の最新性 | 学習時点の情報で固定 | ナレッジベースの更新で即反映 |

| ハルシネーションリスク | 高(自社情報がないため推測で回答) | 低(回答の根拠となるデータを明示) |

| セキュリティ | 入力データがクラウドに送信される | 自社データは自社環境に保管(後述) |

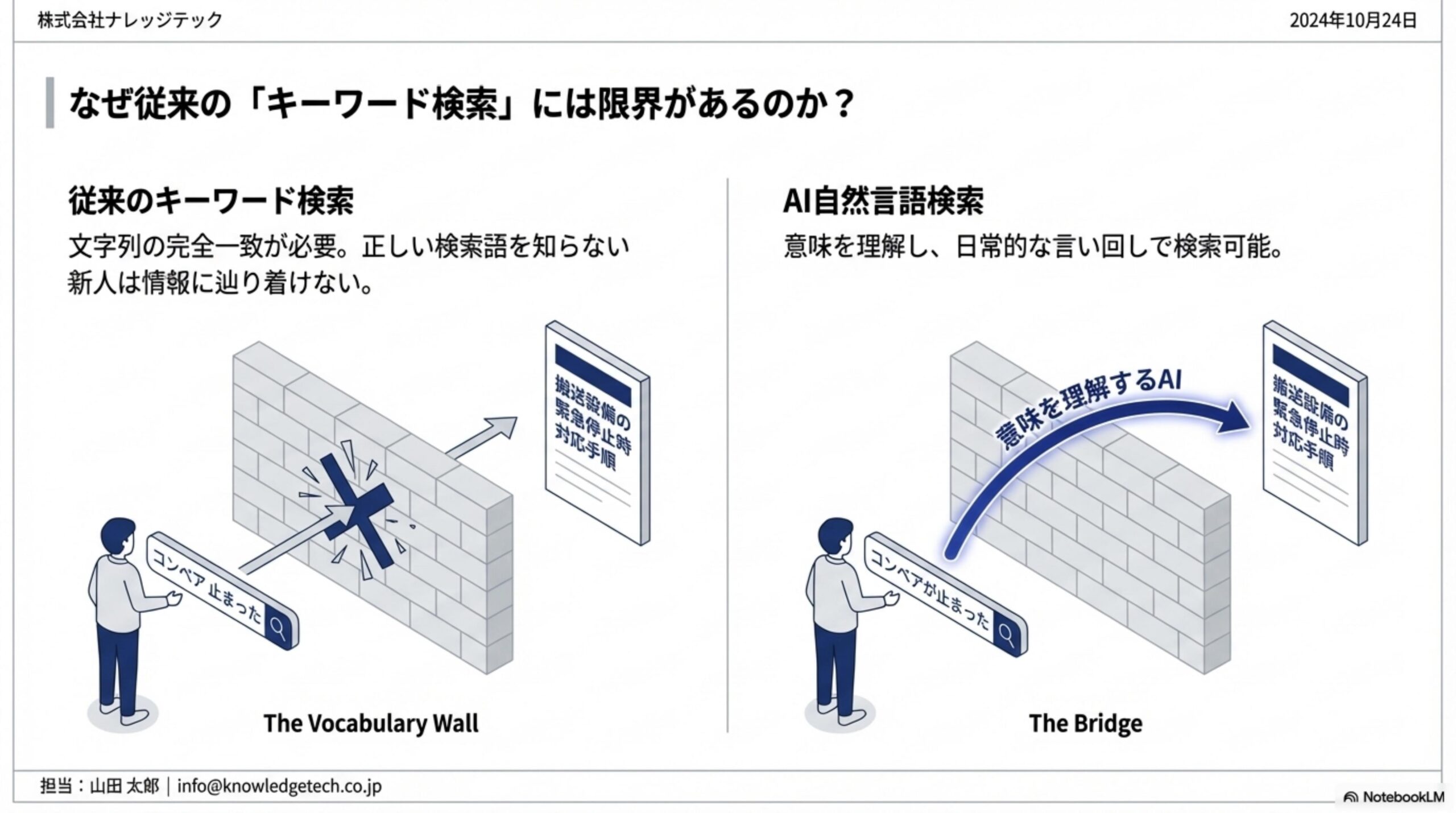

適切に構築されたRAGの回答精度は80〜95%、ハルシネーション率は80〜90%削減されるとされる(AQUA テックブログ)。市場規模はAI活用ナレッジマネジメントシステム全体で2025年に76.6億ドル、2026年には112.4億ドルへの拡大が予測されており(GII調査)、技術的な成熟と導入事例の蓄積が急速に進んでいる。

4. セキュリティ設計――ハイブリッド型アーキテクチャの仕組み

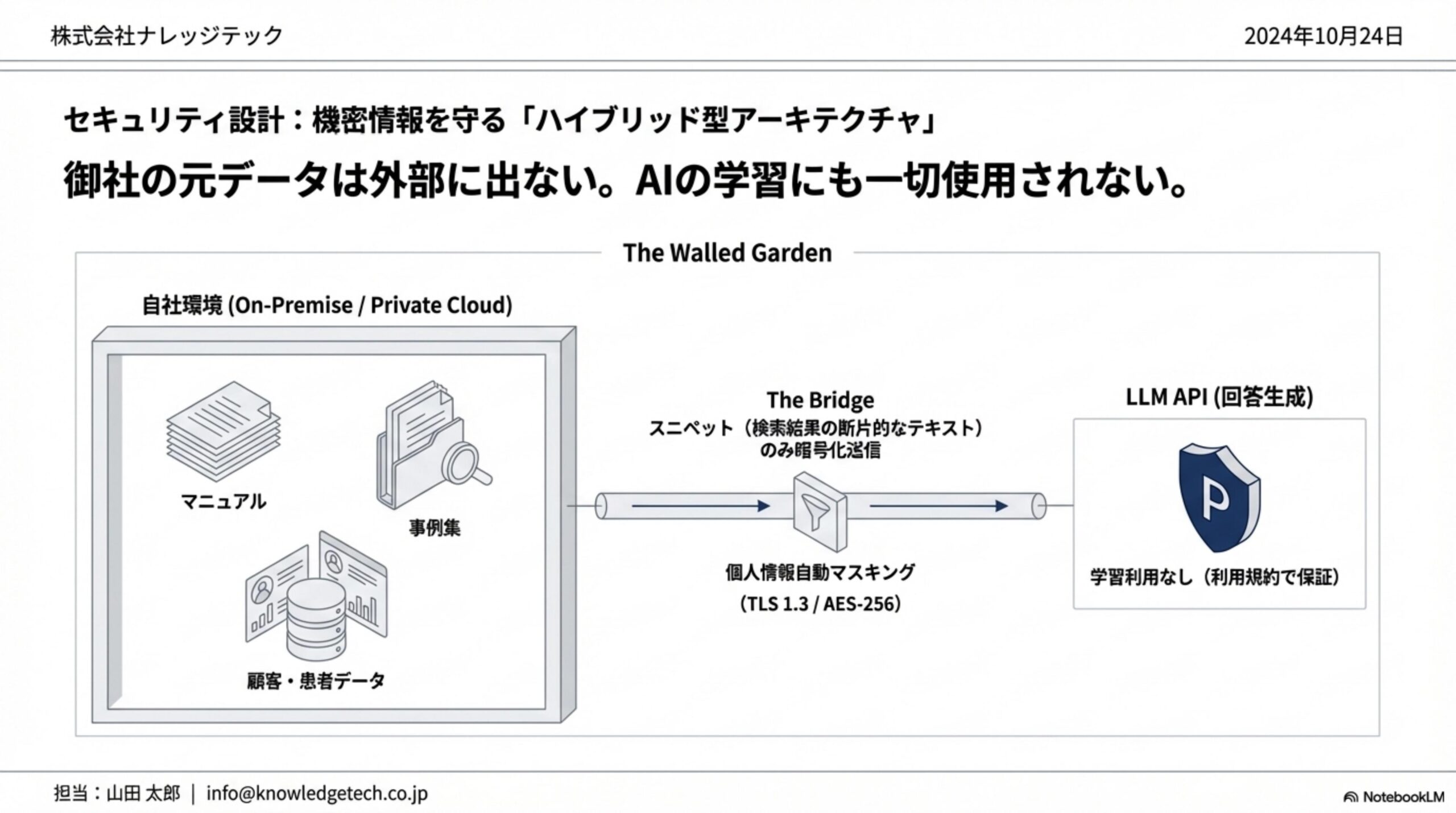

RAGの導入検討で最も多く寄せられる懸念が、「自社の機密情報がAI事業者に漏れるのではないか」というセキュリティの問題だ。製造業の技術ノウハウ、士業の顧問先情報、医療の患者データ——いずれも外部に出ることが許されない情報を扱う。この懸念は正当であり、設計でしっかりと答えるべき問いだ。

ハイブリッド型アーキテクチャとは

ハイブリッド型アーキテクチャとは、「データの保管場所」と「AIによる回答生成」を分離する設計思想だ。元データは自社環境から一切出ない。外部のAIに送信されるのは、回答生成に必要な断片的なテキスト(スニペット)のみ。この分離が、機密保持の核心にある。

─── ポイント ──────────────────────────────────

1. 御社のデータは御社の環境内に保管(外部送信なし)

2. AIに送られるのは「検索結果のスニペット」だけ

3. AIの学習データには一切使用されない

4. 通信はすべて暗号化 + 個人情報は自動マスキングこの設計の要点を4点に整理する。

- 元データは自社環境から出ない — マニュアル、事例集、顧問先情報、患者データ等の元データは自社の環境(オンプレミスまたはプライベートクラウド)に保管する

- 外部に送信されるのはスニペットのみ — 回答生成を行うLLM APIに送信されるのは、検索結果の断片的なテキストのみ

- AIの学習には使用されない — 送信されたデータがAIの学習に使用されないことは、各LLMプロバイダーの利用規約で保証されている

- 個人情報のマスキング — 送信前に個人名・住所等を自動マスキングする多層防御を設ける

業種別のセキュリティ配慮

| 業種 | 保護すべき情報 | ハイブリッド型での対応 |

|---|---|---|

| 製造業 | 技術ノウハウ、品質データ、設備情報 | 全データを社内環境に保管。API送信は回答生成に必要な最小限のスニペットのみ |

| 士業 | 顧問先情報、案件データ、依頼者の秘密 | 守秘義務に配慮した設計。元データは事務所環境内で完結。アクセス権限を案件単位で設定可能 |

| 医療 | 患者データ、カルテ情報、ケア記録 | 患者の個人情報は施設環境内にのみ保管。前処理マスキングとリアルタイムマスキングの二重防御 |

セキュリティ仕様の詳細

| 項目 | 仕様 |

|---|---|

| データ保管 | 自社環境内(オンプレミスまたはプライベートクラウド)で完結 |

| アクセス権限 | 部署・役職ごとに閲覧範囲を設定(RBAC対応) |

| 操作ログ | 全操作を記録。監査対応可能 |

| 通信暗号化 | TLS 1.3 |

| データ暗号化 | AES-256 |

| 個人情報マスキング | 前処理マスキング + リアルタイムマスキングの多層防御 |

| API学習利用 | なし(各プロバイダーの利用規約で保証) |

5. まとめ

RAGは、汎用AIの「自社のことを知らない」という本質的な限界を解決する技術だ。

3つのステップ(質問理解→社内データ検索→回答生成)で、御社専用の「AI社員」として機能する。ハイブリッド型アーキテクチャにより、機密情報のセキュリティも確保される。

RAGを活用した社内ナレッジ管理の全体像については「社内ナレッジ管理をAIで効率化する方法|検索精度を上げる実践ガイド」を、具体的な業種別の活用事例については「AI×ナレッジ管理の導入事例|製造業・法律事務所・介護施設の活用法」を参照してほしい。

本記事は、RAG技術に関する知見を非エンジニア向けにわかりやすく解説したメソッド記事です。

出典・参考データ:AQUA テックブログ、GII市場調査レポート